Quando se fala em Parâmetros de URL muitas pessoas pensam que é apenas um detalhe técnico. Mas, em SEO, detalhe ruim vira problema grande. Eles mudam a forma como uma página é lida, rastreada e consolidada pelos buscadores. E isso afeta desde a indexação até a escolha da versão principal de uma URL.

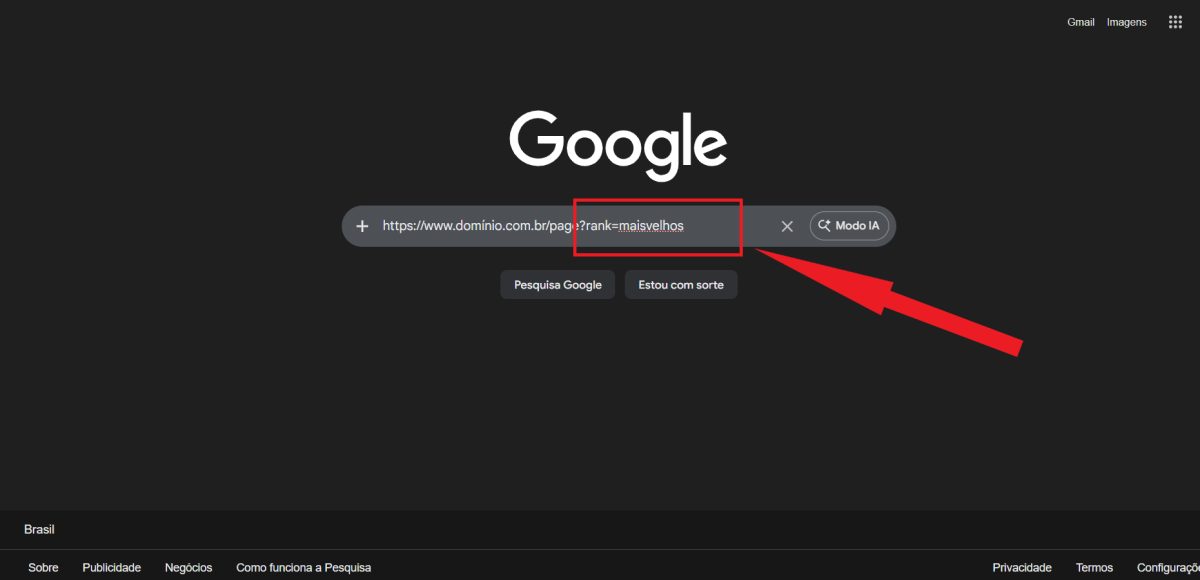

No Google, um parâmetro é uma forma de passar informação por meio da própria URL, com pares de chave e valor.A estrutura básica usa ?, = e &.Na prática, isso significa controle. Também significa risco. Quando bem usados, os parâmetros organizam campanhas, filtros e variações de conteúdo.

Quando mal usados, multiplicam URLs, geram duplicação e drenam recursos de rastreamento.O Google afirma que URLs com muitos caminhos de baixo valor podem prejudicar a eficiência de crawling e indexação, sobretudo em navegação facetada, identificadores de sessão e duplicação interna.

Para quem quer aparecer no Google e também em experiências com IA, o ponto central continua o mesmo: conteúdo útil, bem estruturado e tecnicamente limpo. O Google informa que as melhores práticas de SEO seguem válidas para recursos de IA como AI Overviews e AI Mode, e que não existem otimizações especiais além do essencial. Em outras palavras, clareza técnica ainda vence ruído técnico.

O que são parâmetros de URL?

Parâmetros de URL são informações adicionadas ao fim de um endereço para transportar dados sobre a navegação, a origem do clique ou a versão exibida da página. A lógica é simples: o primeiro parâmetro vem depois de ?, cada par usa =, e múltiplos parâmetros se conectam por &. Exemplo clássico: ?utm_source=google&utm_medium=cpc.

Essa estrutura é útil porque permite segmentar, rastrear e personalizar páginas sem criar um novo caminho base para cada caso. Em um e-commerce, por exemplo, o mesmo produto pode aparecer com cor, tamanho ou origem de campanha diferentes.

O problema começa quando o parâmetro altera pouco ou nada no conteúdo, mas ainda assim gera uma URL tratada como distinta. O Google diferencia essas versões por meio do processo de canonicalização, que escolhe a URL representativa entre páginas duplicadas ou muito parecidas.

Em termos editoriais, pense assim: a URL é o endereço. O parâmetro é a instrução. Às vezes, ele apenas mede. Em outros casos, ele muda a experiência. Saber essa diferença evita uma série de erros técnicos. E, no SEO, a linha entre utilidade e excesso é muito fina.

Como os parâmetros de URL funcionam na prática?

Há parâmetros que modificam a página de modo real. Filtros de categoria, ordenação por preço, paginação e seleção de variantes entram nesse grupo. Nesses casos, o buscador pode encontrar versões diferentes de um mesmo conjunto de conteúdo. Isso não é um problema por si só. O problema surge quando o site não indica qual versão deve ser tratada como principal.

Há também parâmetros cujo papel é quase invisível para o usuário final. UTM, tracking e marcações de origem entram aqui. Eles ajudam a medir campanhas, mas não precisam ser vistos como páginas novas para fins de indexação. O Google explica que parâmetros podem transportar dados de clique e rastreamento, mas isso não implica que cada variação deva ganhar peso editorial ou SEO próprio.

Na prática, a diferença entre um parâmetro ativo e um parâmetro passivo define boa parte da estratégia. O primeiro altera a experiência ou o conteúdo. O segundo registra informação. Confundir os dois costuma gerar páginas redundantes, relatórios poluídos e decisões erradas de indexação.

Por que parâmetros de URL impactam o SEO?

O impacto começa no rastreamento. O Google define crawl budget como o número de URLs que o Googlebot pode e quer rastrear. Em sites grandes, essa limitação importa muito. Quanto mais URLs de baixo valor um site cria, maior a chance de o bot gastar energia em páginas menos úteis. O próprio Google cita navegação facetada, identificadores de sessão e duplicação interna como fontes clássicas desse tipo de desperdício.

O segundo impacto é a indexação. Se uma mesma página pode ser acessada por várias combinações de parâmetros, o buscador precisa decidir qual versão representa melhor aquele conteúdo. Esse processo de canonicalização existe justamente para reduzir duplicidade e mostrar apenas uma versão da informação. Sem sinais claros, o site abre espaço para confusão.

O terceiro impacto é estratégico. Quando a arquitetura gera muitas URLs equivalentes, a autoridade se fragmenta. Os sinais de links internos podem se dispersar entre variantes quase iguais. A leitura editorial também fica mais difícil. Para o mecanismo de busca, e para sistemas de IA que dependem de sinais claros, menos ruído costuma significar mais compreensão.

Principais problemas de SEO causados por parâmetros de URL

Quando um site usa parâmetros sem critério, os efeitos aparecem rápido. O primeiro deles é a duplicação de conteúdo. A mesma página pode existir em várias URLs, com pequenas variações técnicas. O Google já descreveu esse cenário há anos como uma causa direta de conteúdo duplicado, inclusive em páginas acessadas por identificadores e rastreadores.

Outro problema é a criação de espaços infinitos. Um filtro, combinado com outro filtro, combinado com uma ordenação, pode gerar uma expansão quase sem fim de URLs. O Google trata “infinite spaces” como uma categoria de baixa utilidade que afeta o crawling. Em sites grandes, isso pode roubar atenção do bot de páginas que realmente importam.

Há ainda um efeito silencioso: relatórios sujos. Quando a mesma intenção aparece em muitas URLs, o diagnóstico fica confuso. O Search Console oferece relatórios de Crawl Stats e URL Inspection justamente para ajudar a monitorar esse comportamento, mas o ideal é que o site já nasça com uma estrutura que reduza esse tipo de ruído.

Parâmetros de URL e crawl budget

Em sites pequenos, o problema pode passar despercebido. Em sites médios e grandes, ele vira custo. O Google explica que crawl budget combina crawl rate e crawl demand. Isso quer dizer que o robô não acessa tudo o tempo todo. Ele faz escolhas. E essas escolhas respondem ao valor percebido das URLs.

Por isso, parâmetros em excesso podem atrasar a descoberta de páginas novas ou atualizadas. Se o bot perde tempo em combinações pouco úteis, páginas importantes podem receber menos atenção. O efeito não é mágico nem instantâneo, mas é prático. Em SEO técnico, desperdício de rastreamento costuma cobrar juros.

O sinal mais comum de alerta aparece no Crawl Stats do Search Console. Ele mostra totais de requisições, volume baixado e tempo médio de resposta. Já a URL Inspection ajuda a verificar o estado de indexação de uma página específica. Juntos, esses recursos ajudam a identificar quando os parâmetros estão atrapalhando mais do que ajudando.

Como o Google trata parâmetros de URL hoje?

O Google não precisa ser “ensinado” que parâmetros existem. Ele já interpreta esses padrões como variações possíveis de uma mesma base. O ponto decisivo é outro: qual versão deve ser considerada representativa. É aí que entram os sinais de canonicalização, a consistência interna do site e a qualidade da arquitetura.

Quando os sinais são fracos, o buscador pode escolher uma versão diferente da que o site gostaria de destacar. Isso acontece porque o processo de canonicalização funciona como deduplicação. Ele reduz páginas quase iguais a uma única referência principal. Em sites com muitos parâmetros, essa decisão precisa ser sustentada por sinais claros.

Na prática, isso exige disciplina. URLs internas limpas, canonicals consistentes e uso moderado de parâmetros criam um ambiente muito mais previsível para o crawler. Sem isso, o site entrega complexidade demais e orientação de menos.

Como usar parâmetros de URL de forma estratégica no SEO?

Usar Parâmetros de URL exige mais do que saber como eles funcionam. É preciso entender o impacto de cada decisão na indexação, no rastreamento e na arquitetura do site. O Google trata cada combinação como uma URL potencialmente nova, o que exige controle técnico e clareza estrutural.

A seguir, você encontra um guia prático, com aplicações reais e decisões orientadas a SEO moderno.

Tabela: como usar parâmetros de URL de forma estratégica no SEO? Resumo.

| Boas práticas | O que fazer | Impacto no SEO |

|---|---|---|

| Usar parâmetros com variação real | Aplicar apenas quando o conteúdo muda (filtros, paginação, ordenação) | Evita duplicação e melhora a relevância das páginas |

| Evitar indexação de parâmetros de tracking | Usar canonical ou não expor UTMs em links internos | Impede fragmentação de autoridade e URLs duplicadas |

| Definir URL canônica corretamente | Usar rel=”canonical” apontando para a versão principal | Consolida sinais de ranking e evita conflitos de indexação |

| Controlar rastreamento com estratégia | Combinar noindex, canonical e controle de crawling | Otimiza crawl budget e reduz desperdício de recursos |

| Evitar parâmetros em links internos | Priorizar URLs limpas na navegação principal | Fortalece arquitetura do site e direciona melhor o rastreamento |

1. Use parâmetros apenas quando houver variação real de conteúdo

O primeiro critério é simples, mas frequentemente ignorado: só use parâmetros quando eles alterarem o conteúdo exibido de forma relevante. Isso inclui filtros de produtos, ordenações visíveis e paginações que mudam o conjunto de itens apresentados ao usuário.

Se o parâmetro não muda o conteúdo, como acontece com UTMs, ele não deve ser tratado como uma nova página. O Google deixa claro que diferentes URLs podem conter o mesmo conteúdo, e nesses casos a canonicalização será necessária. Criar múltiplas versões sem necessidade aumenta a complexidade e dificulta a consolidação de sinais.

2. Evite indexar parâmetros que servem apenas para rastreamento

Parâmetros de tracking, como UTMs, têm função analítica, não editorial. Eles ajudam a entender a origem do tráfego, mas não devem competir por indexação. Se indexados, podem gerar múltiplas URLs com o mesmo conteúdo, fragmentando relevância.

O ideal é garantir que essas versões não sejam tratadas como páginas independentes. Isso pode ser feito com canonical apontando para a URL limpa ou evitando completamente sua exposição em links internos. Assim, você mantém a coleta de dados sem prejudicar o SEO.

3. Defina corretamente a URL canônica em páginas com parâmetros

Sempre que parâmetros gerarem versões similares de uma página, é fundamental indicar ao Google qual delas deve ser considerada principal. O uso da tag rel=”canonical” é o método mais recomendado para isso.

Sem essa indicação, o buscador pode escolher uma versão arbitrária como canônica. Isso pode gerar perda de controle sobre qual URL aparece nos resultados. Além disso, sinais como backlinks e autoridade podem se dividir entre múltiplas versões, reduzindo o potencial de ranqueamento.

4. Controle o rastreamento com lógica, não com bloqueios cegos

Muitos sites tentam resolver problemas com parâmetros bloqueando tudo via robots.txt. Essa abordagem pode parecer prática, mas é limitada. O Google afirma que bloquear rastreamento não impede necessariamente a indexação, especialmente se a URL for referenciada externamente.

O mais eficiente é combinar estratégias. Use noindex quando necessário, mantenha páginas acessíveis para leitura do crawler e aplique canonical corretamente. O controle deve ser granular e baseado na função de cada parâmetro, não em uma regra genérica.

5. Evite usar parâmetros em links internos estratégicos

Links internos são sinais fortes para o Google. Quando você utiliza URLs com parâmetros nesses links, está indicando que essas versões têm importância estrutural. Isso pode direcionar o rastreamento para caminhos menos relevantes.

Sempre que possível, utilize URLs limpas na navegação principal. Deixe os parâmetros para contextos específicos, como filtros dinâmicos ou campanhas. Essa separação ajuda o crawler a entender quais páginas realmente fazem parte da arquitetura central do site.

Parâmetros de URL vs URLs amigáveis

URLs amigáveis costumam ser melhores para páginas principais porque são mais fáceis de ler, compartilhar e consolidar. Já os parâmetros são melhores quando o site precisa transportar informação dinâmica sem criar novas páginas de conteúdo. O Google não trata isso como uma guerra de formatos. Trata como uma questão de função.

Em páginas centrais, a URL limpa tende a ser mais estável. Em páginas de filtro, campanha e segmentação, o parâmetro pode ser a solução correta. O erro está em usar uma lógica operacional como se fosse lógica editorial. Quando isso acontece, o site perde clareza.

A melhor abordagem é híbrida e disciplinada. A estrutura principal deve ser limpa. Os parâmetros devem existir apenas onde agregam valor real ao negócio, ao rastreamento ou à experiência.

Parâmetros de URL e SEO para IA

As interfaces de busca com IA reforçam uma exigência antiga: páginas fáceis de entender. O Google diz que AI Overviews e AI Mode usam as mesmas bases do SEO tradicional, sem exigir otimizações extras. Isso significa que estrutura, clareza e conteúdo útil continuam sendo a espinha dorsal da visibilidade.

A leitura por IA tende a favorecer conteúdos bem organizados, com sinais estáveis e pouca ambiguidade técnica. URLs limpas ajudam a reduzir ruído. Parâmetros excessivos, por outro lado, podem fragmentar contextos e dificultar a consolidação do tema principal. Não é uma regra isolada da IA. É uma consequência natural de uma arquitetura confusa.

O Google também afirma que conteúdo útil, confiável e feito para pessoas continua no centro dos sistemas de classificação. E avisa que usar ferramentas generativas para criar muitas páginas sem valor pode violar políticas de spam por abuso de conteúdo em escala. Portanto, domínio técnico e qualidade editorial caminham juntos.

Dicas para revisar seus parâmetros de URL

Antes de publicar ou otimizar um site, vale passar por uma checagem objetiva. Primeiro, verifique quais parâmetros realmente mudam o conteúdo. Depois, identifique quais servem apenas para rastreamento. Em seguida, confirme se as URLs duplicadas apontam para a versão canônica correta. Por fim, examine se a navegação interna está espalhando parâmetros desnecessários.

Também vale acompanhar o Search Console com regularidade. O relatório de Crawl Stats mostra o comportamento de rastreamento ao longo do tempo. A URL Inspection ajuda a entender a situação de uma página específica. Já as regras de noindex e robots.txt precisam ser testadas com cuidado, porque uma regra mal combinada pode gerar o efeito oposto do desejado.

Por fim, pense em escala. Um parâmetro inofensivo em uma página pode virar um problema em dez mil. É por isso que o SEO técnico precisa ser prevenido, não apenas corrigido.

Conclusão

Parâmetros de URL não são vilões. Também não são neutros. Eles são instrumentos. Quando bem usados, ajudam a medir, filtrar e organizar. Quando mal administrados, criam duplicação, dispersam sinais e consomem rastreamento sem necessidade. O Google documenta com clareza que canonicalização, noindex, robots.txt, Crawl Stats e URL Inspection são peças centrais dessa gestão.

Em um cenário em que o Google também exibe experiências com IA, a lógica não mudou. O que funciona continua sendo conteúdo útil, arquitetura limpa e sinais técnicos coerentes. Quem domina isso ganha previsibilidade. E, em SEO, previsibilidade costuma ser vantagem competitiva.